hadoop常见指令:

hdfs dfs -copyFromLocal /local/data /hdfs/data:将本地文件上传到 hdfs上(原路径只能是一个文件)

hdfs dfs -put /tmp/ /hdfs/ :和 copyFromLocal 区别是,put 原路径可以是文件夹等

hadoop fs -ls / :查看根目录文件

hadoop fs -ls /tmp/data:查看/tmp/data目录

hadoop fs -cat /tmp/a.txt :查看 a.txt,与 -text 一样

hadoop fs -mkdir dir:创建目录dir

hadoop fs -rmr dir:删除目录dir

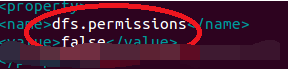

出现 Call From master to localhost:9000 failed on connection exception…的错误。

原因没有打开权限。

修改 /hadoop/etc/hadoop/hdfs.site.xml。

找到dfs.permissions属性修改为false(默认为true)OK了。

出现hdfs.DFSClient: DataStreamer Exception的问题:

原因:在进行namenode格式化时多次造成那么spaceID不一致。

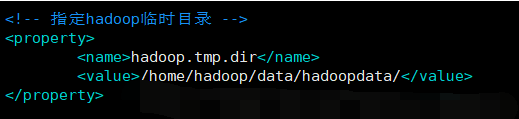

1.删除core.site.xml中临时文件指定的目录。

2.重新进行格式化。

hadoop name -formate 。

3.启动集群。

start-all.sh。

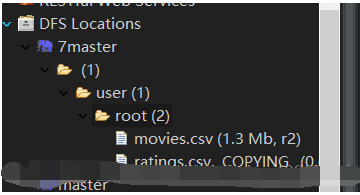

4.创造目录。

hadoop fs -mkdir /user。

hadoop fs -mkdir /user/root。

5上传文件。

hdfs dfs -put movie.csv /user/root/。

原文链接:https://blog.csdn.net/weixin_40990818/article/details/82086213

上一篇:带你认识PHP运行模式

下一篇:没有了

2021-03-23 12:57:06

2021-03-23 12:57:06